Security Researchers Sound the Alarm on Vulnerabilities in AI-Generated Code

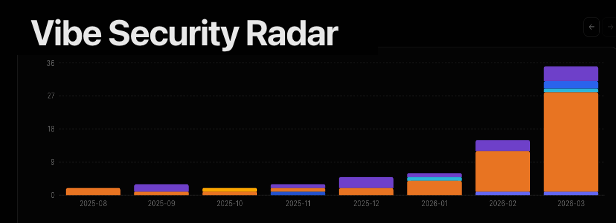

2026/03/27 InfoSecurity — Anthropic の Claude Code などのバイブ・コーディング (Vibe Coding) ツールによる新たな脆弱性が、ソフトウェアへと大量に流入していると、Georgia Tech の研究者たちが警告している。2026年3月には、AI が生成するコードに起因する、35 件の新たな CVE (Common Vulnerabilities and Exposures) が公開された。この数字は、1月の 6 件と、2月の 15 件から大幅に増加している。これらの脆弱性を追跡しているのは、Georgia Tech (ジョージア工科大学) の Systems Software & Security Lab (SSLab) が、2025年5月に立ち上げた Vibe Security Radar プロジェクトである。

AI コーディング・ツール由来の脆弱性を追跡

Vibe Security Radar は、AI コーディング・ツールにより直接導入された脆弱性を追跡することを目的としている。なお、それらの脆弱性は、公的アドバイザリである CVE.org/NVD/GitHub Advisory Database (GHSA)/Open Source Vulnerabilities (OSV)/RustSec などに掲載されたものである。

Vibe Security Radar の創設者である Hanqing Zhao は、「AI コードは安全ではないと言われているが、実際に追跡している人はいない。必要なのは、ベンチマークや仮説ではなく実データであり、実際のユーザーに影響する脆弱性である。」と述べている。

彼は、「バイブ・コーディングによるプロジェクトを、本番環境へ投入するケースが増えている現状においては、この追跡が不可欠である。仮にコード・レビューを行っていても、コード・ベースの半分が機械生成であれば、すべてを検出することは現実的ではない」と付け加えている。

50 種のツールと 74 件の脆弱性を追跡

同大学の研究チームが対象にしているのは、Claude Code/GitHub Copilot/Cursor/Devin/Windsurf/Aider/Amazon Q/Google Jules などの、約 50 種類の AI コーディング・ツールとなる。

Hanqing Zhao は、「Vibe Security Radar の構築においては、最初に公開脆弱性データベースから情報を取得し、修正コミットを特定し、その原因となった変更を逆追跡する。そのコミットに、AI ツールの署名 (co-author タグや bot メールなど) があればフラグを付ける」と説明している。

その後に、AI エージェントを用いて各脆弱性の根本原因を分析し、AI 生成コードの関与を判定する。彼は、「AI エージェントは、Git リポジトリとコミット履歴にアクセスできるため、単なるパターンマッチではなく実際の調査が可能である」と述べている。

確認された74件の CVE のうち、最も多く検出されたのは Claude Code であり、その原因は、Anthropic のツールが常に署名を残すためである。また、Claude Code の比率が高い背景には、開発コミュニティにおける広範な利用があると思われる。その一方で、Copilot のようなインライン補完は痕跡を残さないため、検出が困難であるとされる。

オープンソースに潜む未検出の脆弱性

Hanqing Zhao は、AI コーディング・ツールに起因する CVE の実数は、Vibe Security Radar に表示される件数よりも、確実に多いと述べている。

彼は「現時点で検出できているのは、メタデータが残っているケースのみであり、実際には 5〜10 倍に達すると思われる。つまり、AI により生成された 400〜700 件ほどの脆弱性が、オープンソース全体に存在すると推定される」と述べている。

例として、OpenClaw には 300 件以上のセキュリティ・アドバイザリが存在するが、AI 由来と確認できるのは約 20 件に留まる。その理由は、AI ツールの痕跡が作者により削除されているためである。さらに、CVE や GHSA が付与されない脆弱性も多数存在するため、さらに追跡が困難になっている。

Hanqing Zhao は、「AI コーディング・ツールによる脆弱性は、今後も増加するだろう。2026年2月だけでも、Claude Code は GitHub 上の公開コミットの 4% 以上を占めており、その割合は増加している。AI コードが増えれば、それに比例して脆弱性も増える」と述べている。

Vibe Security Radar プロジェクトは長期的に継続される予定であり、今後はメタデータに依存しない検出手法の開発も進められる。

Hanqing Zhao は、「将来的には、プロジェクト全体/コミットパターン/コードスタイルから AI 生成コードを識別する。AI コードには特有の特徴があり、それを検出するモデルを開発中である」と結論づけている。

訳者後書:Georgia Tech の研究チームが公開した、バイブ・コーディング・ツールに起因する脆弱性の急増に関する警告について解説する記事です。この問題の背景にあるのは、Claude Code や GitHub Copilot といった AI ツールが生成したコードが、十分なセキュリティ検証をされない状態で、本番環境へと大量に組み込まれている現状です。

研究チームが立ち上げた Vibe Security Radar プロジェクトの調査によると、2026年3月だけでも、AI 生成コードが原因とされる 35件の CVE が新たに特定され、累計で 74 件に達していますが、研究チームは氷山の一角に過ぎないと指摘しています。なぜなら、多くの開発者が AI を使った痕跡を消去してからコードを投稿しているため、実際にはその 5 倍から 10 倍である、数百件規模の AI 由来の脆弱性がオープンソース・ソフトウェアに紛れ込んでいる可能性があるからです。

このような調査の結果がフィードバックされ、バイブ・コーディング・ツールの改善に反映されると、状況が速やかに改善されていく可能性もありますね。とても興味深い展開です。よろしければ、カテゴリー SecTools も、ご参照ください。

You must be logged in to post a comment.