7,000 Exposed Ollama APIs Leave DeepSeek AI Models Wide Open to Attack\

2025/02/07 HackRead — 実行中の AI モデルへのアクセスを提供する、オープンな Ollama API に関連する脆弱性を、サードパーティ・リスク管理企業 UpGuard のサイバーセキュリティ研究者たちが特定した。これらのオープン API は、モデル所有者にセキュリティ上のリスクをもたらすだけではなく、DeepSeek などの特定の AI モデルの採用率と地理的分布といった、データを測定するユニークな機会も提供してしまう。

モデルの選択とダウンロードのためのユーザー・フレンドリーな UI を提供する Ollama は、モデルとインタラクションを簡素化するための AI モデル・フレームワークである。ただし、HackRead に公開された UpGuard の調査によると、この API にはパブリック・インターネットに公開される可能性があるという。AI モデルに関連するプッシュ/プル/削除などの機能により、データが危険にさらされる可能性がある。具体的に言うと、未認証のユーザーが、標的とするモデルに対して集中的にリクエストを送信することで、クラウドのリソース所有者にコストが生じる可能性があるという。また、Ollama 内の既存の脆弱性が悪用される可能性もある。

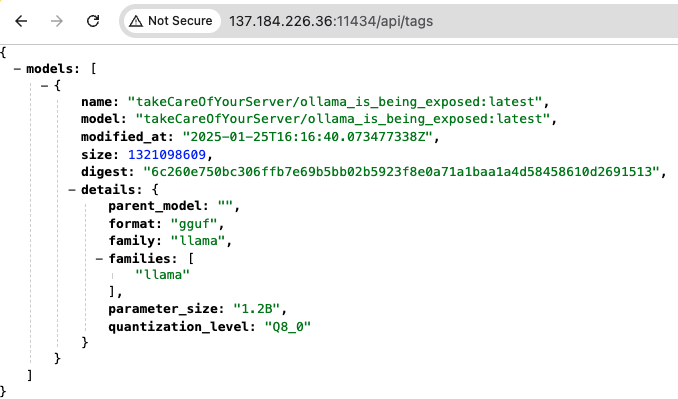

UpGuard の調査によると、すでに脆弱性が悪用され、標的の IP が改竄された証拠があるという。

A screenshot provided by UpGuard to Hackread.com shows an Ollama instance where the models appear to have been deleted.

UpGuard が 提供したスクリーンショットでは、Ollama インスタンスが示されているが、モデルは削除されたように見える。

おそらく Ollama API は、趣味人の自宅や小規模企業のインターネット接続または、大学のネットワークで使用されている。それらのシステムの侵害は容易であるため、将来の攻撃のためのボットネットに組み込まれている可能性があると、研究者たちは懸念を表明している。

UpGuard は、オープンな Ollama API で実行されている、各種のパラメータ・サイズと、DeepSeek モデルの分布も分析した。公開された DeepSeek モデルの中で、最も一般的に見られたのは 14b/7b オプション (140億/70億のパラメータを持つモデル) であり、数多くのユーザーが、これらの中規模モデルを選択していることが示唆される。

現時点において、約 7,000 の IP アドレスが Ollama API を公開し、この3ヶ月の間に 70% 以上も増加していることが示されている。このベースになるのは、2024 年11月の Laava の調査であり、その時には約 4,000 の IP アドレスが見つかっていた。それらの公開された IP のうちの 700 が、何らかのバージョンの DeepSeek を実行している。具体的には、334 社が deepseek-v2 ファミリーのモデルを利用し、434 社が新しい deepseek-r1 モデルを実行しているという。

地理的に見ると、DeepSeek モデルを実行している IP が最も集中するのは、中国の 171 IP アドレス (24.4%) であり、それに続くのが、米国の 140 IP アドレス (20%)、ドイツの 90 IP アドレス (12.9%) である。

さらに、米国内の ISP の 分析による DeepSeek モデルの分布では、Google LLC や AT&T Enterprises LLC などの大規模な組織から、小規模なプロバイダーや大学にいたるまでの、さまざまな規模のプロバイダーが存在していることが判明している。また、研究者た発見したのは、DeepSeek インスタンスが最も集中しているのは中国/米国/ドイツであり、他の国は割合が小さいことである。

Upguard の Director of Research and Insights である Greg Pollock は、「この調査で私たちを驚かせたのは、公開されている Ollama API が急速に増加していること、そして、DeepSeek が急速に普及していることの2つである。どちらも将来大きな影響を及ぼす可能性がある」と述べている。

DeepSeek に関して注目すべきことは、中国政府へのデータ漏洩の懸念から、米海軍/テキサス州/NASA/イタリアなどの団体により、利用が制限されていることだ。これらの懸念は、オープンソース・モデルには当てはまらないとも思えるが、大半のユーザーはコードを精査しないと、UpGuard の研究者は指摘している。

したがって、AI データの漏洩を防ぐには、公開されている Ollama API の攻撃対象領域を監査し、どの AI モデル/AI 製品において、サードパーティ・リスクの管理が重要になるのかを、常に認識しておく必要がある。

このブログでは3件目となる、Ollama の脆弱性に関する記事です。DeepSeek などの登場により、AI の普及が進む一方で、そのインフラの脆弱性が悪用されるリスクも高まっています。よろしければ、以下のリストも、カテゴリ _AI/MLと併せて、ご参照ください。

2024/11/03:Ollama に6つの脆弱性:AI モデルの盗用と汚染

2024/06/24:Ollama に CVE-2024-37032:リモート・コード実行

You must be logged in to post a comment.