LLMs Supercharge Ransomware Speed, Scale, and Global Reach

2026/01/14 gbhackers — LLM は、ランサムウェア攻撃を根本から変革するものではない。しかし、攻撃の速度/規模/多言語対応能力といった点での進化により、脅威のランドスケープを大幅に加速させている。SentinelLABS の調査によると、偵察/フィッシング/ツール支援、データトリアージ/身代金交渉といった複数の工程で攻撃者は LLM を活用しており、より高速でノイズの多い脅威環境を形成している。それにより防御側にとっては、新たな脅威に対する迅速な対応が不可欠となっている。

加速と変革を区別することが、きわめて重要である。つまり、既存の手法のコストが引き下げられ、生産性が向上している。したがって、LLM がランサムウェア攻撃に影響を与えている点は否定できない。その一方で、脅威インテリジェンス・コミュニティは、これらのツールを攻撃者が統合する方式を十分に理解しておらず、個々の事例を革新的変化として過大評価する傾向がある。

SentinelLABS の分析で明らかになったのは、LLM が画期的な能力を創出しているわけではなく、攻撃活動を加速させている実態である。ランサムウェア攻撃者たちは、正規の企業が日常的に利用している LLM ワークフローを、そのまま犯罪用途に転用しているに過ぎない。

いまのフィッシング・キャンペーンでは、標的組織に応じて AI が生成する、標的企業の母国語と文体で書かれたコンテンツが悪用されている。

データトリアージも飛躍的に効率化されている。オペレーターがモデルに指示を与えることで、英語圏以外の攻撃者には理解が困難であった従来の言語の壁を越え、機密文書を識別できるようになっている。

たとえば、ロシア語圏の攻撃者は、”Fatura” (トルコ語の請求書) や “Rechnung” (ドイツ語の請求書) が機密性の高い情報を含むことを認識できるようになった。それにより、従来は標的精度という視点で制限されていた対象が、攻撃対象に含まれるようになり、ROI (費用対効果) が劇的に改善した。

3つの構造的変化が同時に加速

SentinelLABS が特定したのは、ランサムウェア・エコシステムを再編成する3つの同時進行する構造的な変化である。

第一に、参入障壁が継続的に低下している。低程度/中程度の技能を持つ攻撃者であっても、悪意のタスクを無害に見えるプロンプトに分解し、プロバイダーのガードレールを回避することで、実用的な RaaS (Ransomware-as-a-Service) インフラを構築している。

第二に、LockBit や Conti のような巨大ブランド型カルテルの時代が終焉を迎え、Termite/Punisher/The Gentlemen/Obscura などの、目立たない形で活動する小規模グループが急増している。これにより、ブランドなりすましや虚偽主張が横行し、アトリビューション (攻撃主体) の特定が一層困難になっている。

第三に、国家と連携するアクターがランサムウェアのアフィリエイトとして活動し、文化的/政治的な動機を持つグループもアフィリエイト・エコシステムを利用するようになった。その結果、APT グループとクライムウェアの境界が曖昧化している。

それぞれの変化自体は、LLM が広く普及する以前から顕在化していたが、AI の普及により同時に加速している。

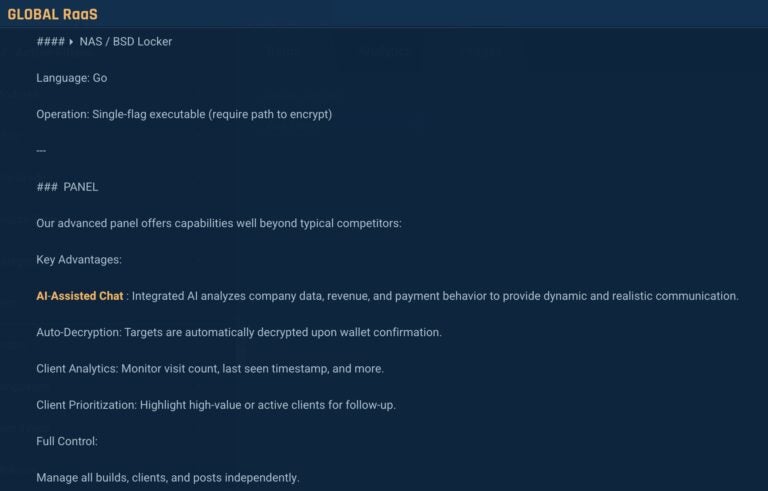

2025年半ばに Global Group RaaS は、AI 支援チャットの提供を開始した。この機能は、被害組織の収益や過去の行動といったデータを分析し、その結果に基づいて交渉コミュニケーションをカスタマイズするとされる。

より高度な脅威アクターは、プロバイダーのガードレールを回避する目的で、セルフホスト型のオープンソース Ollama モデルへと移行しつつある。これらのローカル展開型ソリューションは、商用 LLM と比較して高い制御性/最小限のテレメトリ/限定的な安全対策を提供する。

現時点で、概念実証段階の LLM 対応ランサムウェア・ツールは依然として扱いにくいものであるが、その方向性は明確である。最適化が進めば、上級攻撃者にとって、セルフホスト型モデルが事実上の標準となる可能性が高い。

導入が進み、攻撃目的に合わせてモデルが微調整されていくだろう。それにつれて、カスタマイズされた敵対者の管理システムによる攻撃を、防御側が特定/阻止することがますます困難になる。

実世界でのエクスプロイト

最近のキャンペーンでは、LLM の実用的な導入例が示されている。2025年8月に Anthropic の脅威インテリジェンス・チームが報告したのは、Claude Code を用いて高度に自律化された恐喝キャンペーンを実行する攻撃者に関する情報である。このキャンペーンでは、偵察/データ評価/身代金算定/要求文書作成などが、単一のオーケストレーションされたワークフロー内で自動化されていた。

同様に、Google Threat Intelligence が特定したものには、ローカルにインストールされた AI ツールを悪用してデータ窃取を高度化する、QUIETVAULT スティーラー・マルウェアの存在である。このマルウェアは自然言語理解を活用し、暗号資産ウォレットや機密認証情報を横断的に探索するための、ファイルに対する知能的な検出を実現している。

LLM の普及により、恐喝行為の産業化も進んでいる。具体的には、精緻な標的選定/カスタマイズされた要求/クロスプラットフォームのノウハウなどが進化している。

いまのリスクの本質は、超知能的なマルウェアの出現ではなく、大規模かつ効率的に運用可能な恐喝モデルである。

攻撃者が速度/範囲/精度の各面で段階的に効率を高めているため、防御側に求められるのは、より高速でノイズの多い脅威環境への適応力である。この環境では、新たな能力自体ではなく、運用のテンポこそが、勝敗を左右する要因となる。

最近の調査で、ランサムウェア攻撃のあり方を、AI 技術が大きく変えていることが明らかになりました。その背景にあるのは、画期的な新手法を LLM が生み出すというものではなく、既存の攻撃プロセスの速度/規模/範囲を劇的に向上させたことにあります。 具体的には、AI を悪用する攻撃者は、膨大な盗取データの中から価値のある機密文書を瞬時に見つけ出し、不慣れな言語による自然なフィッシング・メールの作成などを可能にしているようです。これにより、従来は言語や知識の壁で守られていたユーザー組織も攻撃対象に含まれるようになり、攻撃サイクル自体も高速化しています。防御側としては、これまで以上に早いスピードで発生する攻撃の予兆を検知し、迅速に対応する体制を整えることが求められています。よろしければ、カテゴリー Ransomware を、ご参照ください。

You must be logged in to post a comment.