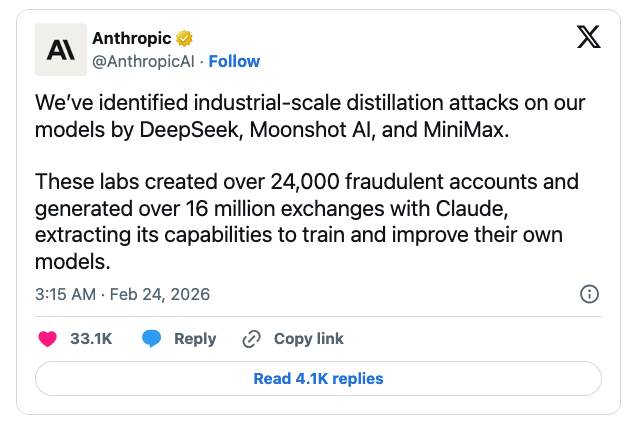

Anthropic Claude Under Large Scale Distillation Attacks By Chinese AI Labs with 13 Million Exchanges

2026/02/23 CyberSecurityNews — Anthropic が主張するのは、DeepSeek/Moonshot AI/MiniMax の 3 社が、同社 Claude モデルから高度な能力を窃取するために、協調的な蒸留 (Distillation) キャンペーンを実行したという件である。サンフランシスコ拠点の同社によると、このオペレーションは約 24,000 件の不正アカウントを介して実行され、Claude との 1,600 万回超のインタラクションを発生させた。これは利用規約 (ToS:Terms of Service) に違反し、リージョナル・アクセス制限を回避する行為である。

同社によると、それぞれの中国企業のラボは、プロキシ・サービスおよび Hydra Cluster と呼ばれる偽アカウント群ネットワークを用いて、その活動を隠蔽し検知を回避してきたという。

蒸留 (Distillation) とは何か? なぜ問題なのか?

Distillation とは、小規模な Student モデルが大規模な Teacher モデルの出力から学習する、標準的な AI 学習手法である。最先端のラボは、自社モデルの低コスト化/高性能化を達成するために、この手法を日常的に用いる。

しかし、競合モデルにより不正に適用されると、オリジナル開発のコストと時間のごく一部で、モデルの能力が高速で移転されてしまう。

Anthropic が強調するのは、Distillation により生成された Claude のコピーは、米国の Frontier モデルに組み込まれた強固な安全対策を維持できない可能性が高いという点だ。これら安全対策は、生物兵器開発や悪意のサイバー作戦などへの悪用防止を目的とするものである。

こうした保護なき能力が、権威主義の政府により軍事/情報/監視システムへ組み込まれる可能性がある。また、オープンソース化により、単一の国家の統制を超えて拡散する可能性もあると、同社は警告している。

3 つのキャンペーン

DeepSeek

- 規模:150,000 回超のインタラクション

- 標的:高度推論/ルーブリック型評価 (報酬モデル学習用)/政治的に敏感な質問に対する検閲回避代替回答

- 手法:複数アカウント間の同期トラフィック/共有決済手段/段階的 chain-of-thought 推論抽出を狙うプロンプト

Moonshot AI ( Kimi モデル )

- 規模:340 万回超のインタラクション

- 標的:agentic 推論/ツール使用/コーディング/データ分析/computer-use エージェント/computer vision

- 手法:複数アクセス経路にまたがる数百の不正アカウント/後期段階では Claude の推論トレース再構築へ集中

MiniMax

- 規模:1,300 万回超のインタラクション

- 標的:agentic コーディング/ツール使用オーケストレーション

- 手法:Anthropic が新モデルを公開後 24 時間以内に pivot/トラフィックの約半分を新システムへ再配分

Anthropic が行った帰属判断は、IP 相関/リクエストメタデータ/インフラ指紋/業界パートナーからの裏付けによる高い確度を持つものだ。ある事例では、リクエスト・メタデータが、それぞれのラボの上級研究者の公開プロフィールと直接一致した。

制限回避の手法

Anthropic は、中国市場において Claude の商用アクセスを提供していない。したがって、それぞれのラボは、サードパーティ・プロキシ・サービスを通じアクセスを購入した。これらサービスは、API 呼び出しを大規模に再販するものだ。

これらサービスにより、不正アカウントの大規模ネットワークが運営される。そして、Distillation トラフィックを正規顧客リクエストと混在させる。そのため、検知は著しく困難となる。

Anthropic 社は、chain-of-thought 抽出検知用分類器や行動指紋分析などの、新たな検知システムへ大規模投資を進めると述べている。

さらに、他 AI ラボ/クラウドプロバイダー/当局と、技術指標を共有している。そして教育/研究アカウントの検証強化も進めている。これらアカウントは、この種のスキームで悪用されやすい。

Anthropic が強調するのは、単一の企業では解決できない問題であることだ。そのため、AI 業界/クラウド事業者/政策当局による協調対応を呼びかけている。

同社は、米国による先端チップの輸出規制に対して、改めて支持を表明している。そして、Distillation 攻撃は規制の必要性を補強すると主張している。チップ・アクセス制限は、直接的な学習能力だけでなく、不正なデータ抽出の規模も制限する。

先日には、OpenAI が米国議員に対して、ChatGPT などの米国モデルに対する、DeepSeek による Distillation 活動を警告している。それから数週間後に、今回の情報開示が行われた。

中国の主要 AI ラボ 3 社 (DeepSeek/Moonshot AI/MiniMax) に対して、Anthropic が名指しで批判しました。 このニュースが明らかにしたのは、AI 業界における “知財の窃取” と “安全の保障” の境界線が、きわめて曖昧になっている現状です。この問題の核心は、単なる規約違反を超えたモデル蒸留 (Distillation) という手法の、政治的/軍事的な悪用にあります。蒸留という手法自体は、AI の効率化に不可欠な技術ですが、1,600万回を超える膨大なインタラクションを通じて、Claude が持つ高度な推論能力やコーディング・スキルを丸裸にする行為は、米国のモデルが築き上げた競争優位性を一瞬で無効化する恐れがあるものです。これまでには無かった、新たな知的財産侵害の形態です。

You must be logged in to post a comment.