Shadow AI risks deepen as 31% of users get no employer training

2026/05/01 HelpNetSecurity — エンタープライズのフルタイム従業員 6,000 人を対象としたグローバル調査によると、従業員の 5 分の 1 から 3 分の 1 が、IT 部門の影響およびガバナンスの外側で AI を利用している。従業員による AI 導入の拡大と、それを管理するためのガバナンスとの間にギャップが拡大していることを、研究者たちが明らかにした。

Lenovo Work Reborn Research Series 2026 レポートは、労働力が 2 つのグループに分断されていることを示している。IT 管理ツール/トレーニング/監督を備えた従業員たちと、コンシューマ AI サービスを用いて独立に業務を行う従業員たちである。

トレーニングおよびツール不足が非承認利用を促進

AI に関するツール/トレーニングを雇用主が提供していないと、多くの従業員が報告している。また、トレーニングを受けた従業員の多くが、その内容に対して効果が低く、継続的なものではなかったと評価している。

全従業員の半数は、より良いトレーニングがあれば、業務における AI 活用価値を高められると回答している。それが示唆するのは、AI を採用する準備が、企業よりも従業員側で整っている状況である。

AI に対する従業員の関心は継続的に上昇している。週に数回以上 AI ツールを利用する従業員が 70% に達し、今後の 1 年で利用が増加すると従業員の 80% が予測している。企業の管理/支援/整合の能力を、AI 導入の速度が上回っていると、Lenovo の調査が示している。

管理外導入に伴うセキュリティ影響

このレポートでは、シャドウ AI に関連する 2 つのセキュリティ懸念を指摘している。

- コンプライアンス制御の回避により、知的財産や機密データが管理環境外で処理されることでリスクが増大する。

- 分断されたワークフローにより一貫性が欠落し、ガバナンスの適用範囲にばらつきが生じる。

従業員が抱く、企業提供ツールに対する信頼にも揺らぎが見られる。相当数の従業員が、企業が提供する AI ツールの出力の信頼性に疑問を持ち、プライバシーや個人データの安全性に懸念を示す人々も増えている。

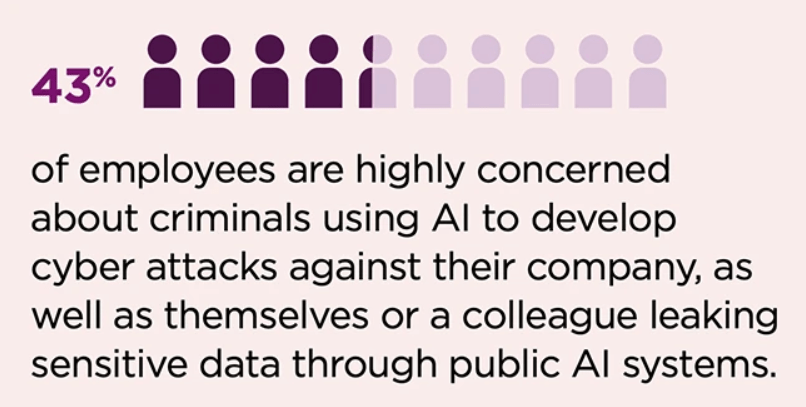

なお、サイバー・セキュリティに対する従業員の認識は均一ではない。約半数が、犯罪者による高度な AI サイバー攻撃の開発に強い懸念を抱いている。それと同時に、ChatGPT などの公開 AI システムを通じた機密情報の漏洩にも同程度の懸念がある。

ディープフェイク・ビデオや AI 生成フィッシング・メールに対して、40% の従業員が強い懸念を示している。その一方で、企業の AI システム自体への攻撃に強い懸念を持つのは 23% に留まる。この認識の差は、AI エージェントや内部 AI インフラ導入が進む中で重要性を増していく。

これらの認識は、Lenovo CIO Playbook の結果とも一致する。このレポートでは、AI によりサイバー・セキュリティ・リスクが増大していると、61% の IT リーダーが回答している。ただし、これらのリスクに対応できると確信しているのは 31% に留まる。

従業員がセキュリティチームに求めるもの

AI 関連リスクに関するサイバーセキュリティ・トレーニングの強化が安心感につながると、74% の従業員が回答している。企業のセキュリティ・チームが、AI を活用して対策していることを知ると安心すると、73% が回答している。AI 利用に関する厳格なポリシーが安心感をもたらすと、70% が答えている。

このレポートが推奨するのは、AI 導入が拡大する前にガバナンスを構築し、継続的かつコンテキスト内での学習により、業務フローへセキュリティ意識を組み込むことだ。さらに、ワークフローおよびエンドポイント全体で、AI インターフェイスを標準化することも重要である。

企業が提供する管理の外で、従業員が独自に AI を利用するシャドウ AI の拡大に関する調査結果が公開されました。AI を業務に活用したいという従業員の意欲や導入スピードに対し、企業のトレーニング提供やガバナンス体制の整備が追いついていないことが、一連の問題の背景にあります。適切な教育やツールが不足しているため、従業員が個人向けの AI サービスを無断で業務に使い始めてしまい、結果として機密データや知的財産が管理外の環境へ流出するリスクが高まっています。また、AI が生成した情報の信頼性や、プライバシーへの懸念も広がっており、従業員の多くは企業による明確な利用ポリシーや AI 時代の新しいセキュリティ研修を求めています。 AI を安全に使いこなすためには、標準化されたツールの導入と、業務の流れに沿った継続的な学習機会を提供し、企業と従業員の間のギャップを埋めることが不可欠です。よろしければ、Shadow AI での検索結果も、ご参照ください。

You must be logged in to post a comment.