New AI Tool ‘FraudGPT’ Emerges, Tailored for Sophisticated Attacks

2023/07/26 TheHackerNews — WormGPT の足跡をたどる脅威アクターたちは、さまざまなダークウェブ・マーケットプレイスや Telegram チャンネルで、FraudGPT と名付けたサイバー犯罪生成 AI ツールを宣伝している。7月25日 (火) に発表されたレポートの中で、Netenrich の Security Researcher である Rakesh Krishnan は、「これは AI ボットであり、スピアフィッシング・メールの作成/クラッキングツールの作成/カーディングなどの攻撃に特化したものだ」と述べている。Netenrich によると、このサービスは遅くとも 2023年7月22日以降において、月額 $200 (半年 $1,000/1年 $1,700) で提供されているという。

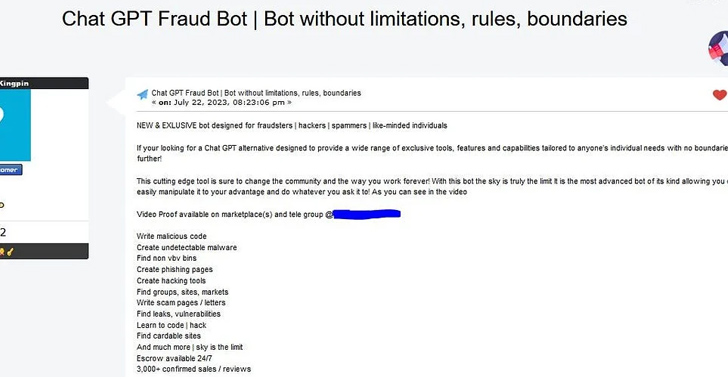

オンライン・エイリアスである CanadianKingpin は、「あなたの望みが、あらゆる目的に対応するツールにあり、境界線のない広範囲をカバーするように設計された、ChatGPT の代替品にあるなら、もう、何も探す必要はなくなる」と主張している。

さらに、この脅威アクターは、「悪意のコードの記述/検出不可能なマルウェアの作成/リークや脆弱性の検出などにも対応できる。すでに、3,000件以上の販売実績があり、その評価はレビューでも確認できる。システムの開発に使用された、LLM は秘密である」としている。

OpenAI の ChatGPT など AI ツールの登場に歩調を合わせるかのように、脅威アクターたちは、あらゆる種類のサイバー犯罪活動を制限なしに促進するために設計された、新しい敵対的亜種を調合するようになっている。

このようなツールは、PhaaS (phishing-as-a-service) モデルを次のレベルに引き上げるだけではなく、高度なフィッシングや BEC による攻撃を大規模に実施し、機密情報窃取/不正送金を仕掛けようとする、新たな脅威アクターたちを育てる環境としても機能する可能性がある。

Rakesh Krishnan は、「ユーザー組織は倫理的な保護策を備えた ChatGPT などのツールを作成できるが、そのような安全策を持たない、同様のテクノロジーを再実装することは容易である。フィッシング・メールからランサムウェアやデータ流出へと、悪意の AI の応用範囲が発展する前に、これらの急速に変化する脅威を発見する必要がある。そのためには、迅速な分析のために利用可能な、すべてのセキュリティ・テレメトリによる、徹底的な防御戦略を導入することが不可欠となる」と指摘している。

どのような生成 AI エンジンが悪用されているのか、そのあたりは不明とのことですが、2023/07/20 の「AI と Open Source の関係:半数以上のプロジェクトで脆弱なパッケージが使用されている」には、「ChatGPT の API はリリースから僅か5ヶ月で、”多様な問題領域”にまたがる 900件の npm/PyPI パッケージで使用されている」と記されています。このような背景をベースに考えると、FraudGPT の登場は当然のことであり、また、この種の悪意のツールの量産が予測されます。

You must be logged in to post a comment.