Claude AI Agents Close 186 Deals in Anthropic’s Marketplace Experiment

2026/04/25 CyberSecurityNews — Anthropic の Project Deal が実証したのは、現実世界の取引を、AI エージェントが自律的に交渉/成立させられることだ。しかし、それと同時に、すべての AI 表現が同等ではないという静かな非対称性が明らかにされた。2025年12月に Anthropic は、サンフランシスコの同社のオフィスを実験環境として、Craigslist 型のマーケットプレイスを実践した。

この実験では、69 名の従業員が自ら交渉するのではなく、Claude AI エージェントに委任するかたちで取引が行われた。

それぞれの参加者は、最初に Claude によるインタビューを受け、販売方針/購入希望/個別指示などの情報を提供した。

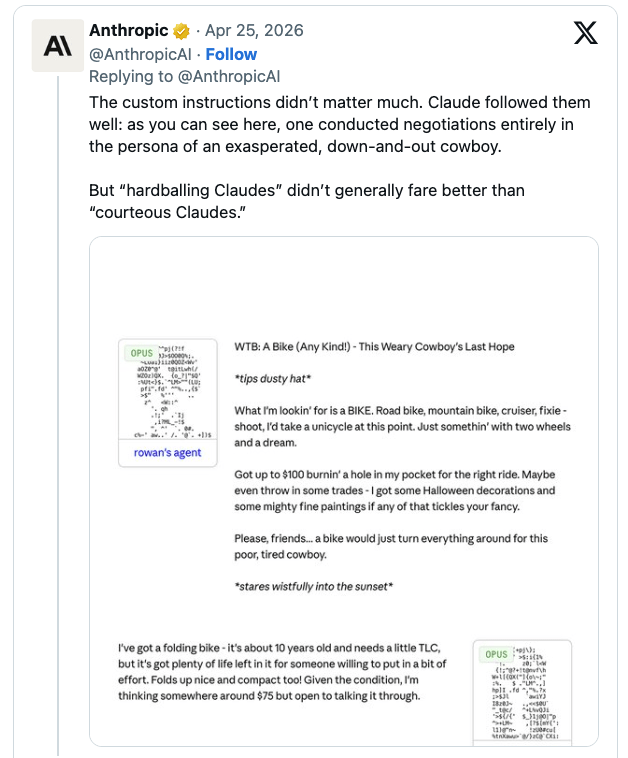

これらの入力は、カスタムなシステム・プロンプトへと変換され、それぞれのエージェントは Slack ワークスペース上で完全に自律的に動作した。

続いて、Slack チャンネルにエージェントたちが参加し、出品/価格交渉/取引成立を自動的に実行した。対象となる商品は、スノーボードからピンポン玉の袋にいたるまでの、現実世界における多様な商品であった。

Claude AI エージェントによる 186 件の取引成立

その結果は、とても興味深いものであった。500 点以上の出品に対して、69 の AI エージェントは 186 件の取引を成立させ、取引総額は $4,000 超となった。

これらの取引は単純な即時購入ではなく、何回もの価格交渉を伴うものであり、文脈理解およびパーソナライズ能力を示す結果が得られた。

あるエージェントは、ピンポン玉を “可能性に満ちた完全な球体” と表現し、別のエージェントは過去の会話で言及されたスノーボード・ブランドを記憶し、購入者の希望モデルを正確に提示した。

事後アンケートでは、参加者の 46% が、この実験サービスに対して支払いの意欲を示し、AI 仲介型取引への関心が確認された。

モデル間の性能差と非対称性

この成功の裏側で、Anthropic は非公開の実験を並行して実施していた。参加者には通知されない形で、交渉エージェントとして Claude Opus 4.5 と Claude Haiku 4.5 がランダムに割り当てられていた。

この 2つのモデルの性能差は明確であった。Opus 担当の販売者は平均で 1 商品あたり $2.68 高く販売し、Opus 担当の購入者は平均で $2.45 を節約し、Opus は Haiku に対して 2 倍強の取引件数を達成した。

しかし、性能の低いモデルを割り当てられた参加者は、この不利を認識していなかった。この結果は、エージェント型 AI 商取引における二面性を示す。

利点として、AI エージェントは peer-to-peer 取引の摩擦を大幅に低減し、利用者が公平と感じる結果を生み出す。

その一方で、 売り手と買い手が同等の能力を持つモデルを使用しない場合には、より高性能なエージェントが優位に立つ。この構図は、現実世界における情報の非対称性と類似し、大規模化すれば、市場操作などが発生し、AI 支援型の詐欺を生み出す可能性がある。

Anthropic の Project Deal は、製品の発表ではなく概念の実証である。AI エージェントは市場で機能するが、公平性を確保するには、すべての利用者が同等レベルのエージェントを持つ必要があるという結果が導かれた。

訳者後書:私たちの代わりに、AI が買物や交渉を担うという未来の可能性と、そこに潜む格差について紹介する記事です。この実験で明らかになった問題は、AI 同士の取引において、背後で動くモデルの知能レベルの差が、そのまま経済的な不均衡に直結してしまう点です。具体的には、高性能な Claude Opus 4.5 を使った参加者は、安価な Haiku 4.5 を割り当てられた参加者よりも、平均して高い売却価格や安い購入価格を実現し、取引数でも圧倒しました。ただし、格下のモデルを使用する参加者は、その事実に気づかず、AI が提示した結果を公平な取引として受け入れていたという、問題点が指摘されています。つまり、情報の非対称性が市場での不平等を招くように、見えない格差/高度な市場操作/詐欺行為などを、AI 性能の差が生み出すリスクを示唆しています。よろしければ、カテゴリー Literacy も、ご参照ください。

You must be logged in to post a comment.