LastPass: Hackers targeted employee in failed deepfake CEO call

2024/04/11 BleepingComputer — 今週に LastPass が明らかにしたのは、ディープフェイク音声を使って同社の CEO Karim Toubba になりすますという、音声フィッシング攻撃を受けたことだ。しかし、McAfee による最近のグローバル調査によると、25% の人々が AI 音声を用いるなりすまし詐欺の被害にあった、もしくは、知り合いが被害にあったと回答している。ただし、その LastPass の従業員は、攻撃者が WhatsApp を使用していたことを、つまり、きわめて珍しいビジネス・チャネルを使っていたことを不審に思い、被害には至らなかったとのことだ。

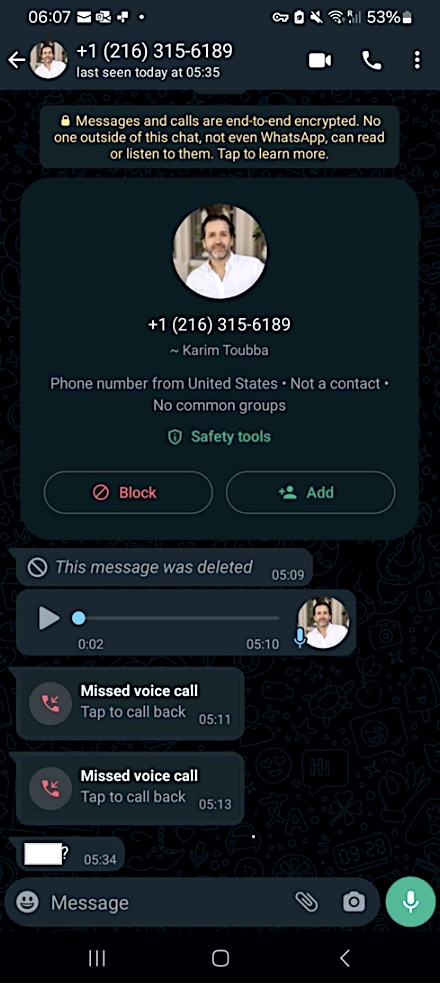

LastPass の Intelligence Analyst である Mike Kosak は、「我々のケースでは、WhatsApp を介して CEO になりすました脅迫アクターからの、一連の電話とテキスト・メッセージを、そして少なくとも1通の音声ディープ・フェイクによるボイス・メールを、ある従業員が受信した。

このような通信の経路と手段は、当社のビジネスコミュニケーション・チャネルから逸脱しており、また、ソーシャルエンジニアリングの特徴である緊急性の強要などを、その従業員が疑っていたことで、それらの悪意のメッセージは無視され、社内セキュリティチームへと報告された」と述べている。

Kosak は、「この攻撃は失敗に終わり、LastPass への影響はなかった。しかし、経営者なりすます詐欺キャンペーンにおいて、すでに生成 AI によるディープフェイクが使用されている外部と共有し、このインシデントの詳細について警告する」と付け加えている。

この攻撃で使用されたディープフェイク音声は、LastPass の CEO の音声 (YouTube コンテンツ?) を学習させた、ディープフェイク音声モデルを使用して生成された可能性が高い。

2022年8月 と 2022年11月にも、LastPass はセキュリティ侵害に遭遇しているが、今回の攻撃は、それらに続くものである。LastPass のパスワード管理プラットフォームは、現時点で世界中で数百万人のユーザーと10万以上の企業に利用されていると、同社は述べている。

増加するディープフェイク攻撃

先週に、米保健福祉省 (HHS) が発出した警告は、ソーシャルエンジニアリングや AI 音声クローンツールを使って、ITヘルプデスクを狙うサイバー犯罪者に関するものだが、LastPass の警告は、それに続くものとなる。

音声ディープフェイクを使用する脅威アクターは、発信者の身元確認を難しくできるため、企業の幹部や従業員になりすました攻撃の発見も、きわめて困難になる。

HHS が共有するアドバイザリは、医療セクターの IT ヘルプデスクを標的とする攻撃に特化しているが、以下の内容は、CEO になりすました詐欺の試みに対しても、大きな効果を持つだろう:

- パスワード・リセットや新たな MFA デバイスを要求する従業員を確認するために、コール・バックを要求する。

- 疑わしい ACH の変更を監視する。

- 潜在的な被害者の Web サイトにアクセスできる、すべてのユーザーを再検証する。

- 機密性の高い事項については、対面での要請を検討する。

- それぞれのリクエストに対して、上司による確認を義務付ける。

- ソーシャル・エンジニアリングのテクニックを特定/報告し、発信者の身元を確認するという文化を定着させるために、ヘルプデスクのスタッフを訓練する。

2021年3月の時点で FBI が発行した Private Industry Notification (PIN) では、「AI が生成/操作する、音声/テキスト/画像/動画などを取り込んだディープフェイクが、ますます巧妙になっている。APT による攻撃や、経済犯によるサイバー攻撃において、ハッカーたちにより広く採用される可能性が高い」と警告されていた。

さらには、2022年4月の時点で Europol も、「ディープフェイクは、CEO 詐欺/証拠改ざん/非合意のポルノ作成において、サイバー犯罪グループが日常的に使用するツールになっていくだろう」と警告していた。

また、LastPass が侵害されたのかと、この記事を見つけたときに思いましたが、従業員の機転により未然に防御されたとのことです。まずは、良かったです。それにしても、生成 AI による音声フィシングが、かなり当たり前のことになっているようです。こうして、こうげきの手法を共有してくれる LastPass に感謝です。よろしければ、LastPass で検索も、ご利用ください。

You must be logged in to post a comment.