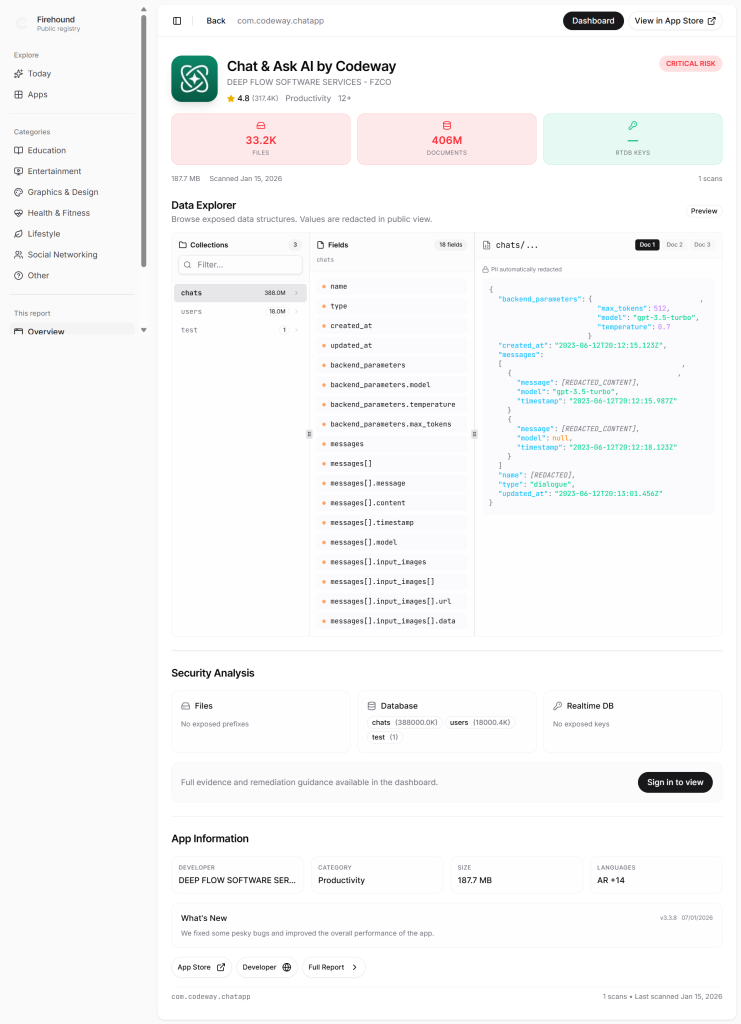

Firebase Misconfiguration Exposes 300M Messages From Chat & Ask AI Users

2026/02/18 hackread — 大規模なセキュリティ障害により、保護されていないデータベースがオンライン上に公開状態で放置され、数百万人のプライベートな会話が危険にさらされた。独立系の研究者により発見された情報漏洩インシデントでは、Chat & Ask AI の 2,500 万人を超えるユーザーの、約 3 億件のメッセージが露出した。このアプリは、Google Play/Apple App Store で、5,000 万回以上もダウンロードされている。

2020年にイスタンブールで設立された、トルコのテクノロジー企業 Codeway が、このアプリを所有している。単一のゲートウェイとして機能する “ラッパー” 型アプリであり、OpenAI の ChatGPT/Google の Gemini/Anthropic の Claudeといった著名な AI モデルとユーザーを接続する仕組みを提供している。複数のシステムへの入口となる設計であるため、たった 1 つの技術的ミスが、世界中のユーザー・プライバシーに甚大な影響を与える結果となった。

単純に開かれていた扉

これは高度なハッキングではない。原因は Firebase のミスコンフィグという、広く知られた技術的エラーである。Firebase は、アプリデータ管理に用いられる Google のサービスであるが、今回のケースは Security Rules が誤って公開設定になっていたことに起因する。その結果、デジタル上の正面玄関が開放された状態となり、誰もがパスワードなしでデータの閲覧や削除が可能となっていた。

一連の流出データに含まれるのは、完全なチャット履歴や、ユーザーが AI ボットに付けた名称などがあると、Harry と名乗る研究者が指摘している。さらに、”違法行為に関する議論” や “自殺支援の依頼” といった、個人的かつ衝撃的な内容も確認された。多くのユーザーが、AI ボットを私的な日記のように扱っている現状を踏まえると、この露出はきわめて深刻な問題である。

初めてのことではない

AI チャット・プラットフォームがデータ露出インシデントに直面したのは、今回が初めてのことではない。以前には、OmniGPT が侵害を受け、機微なユーザー情報が流出した。それが示すのは、厳格なバックエンド保護策なしに AI ツールを導入した場合に、プライバシー・リスクが急速に拡大することである。

技術的な原因が異なっても、従来型のアプリケーション・セキュリティ障害と、きわめて個人的な会話を保存する AI サービスが交差するという構図は共通している。その結果、通常のデータ漏えいを遥かに超える影響が生じる。

AI ユーザーへの教訓

この問題を発見した Harry は、さらに調査を進めた。同様の脆弱性を検出するツールを構築し、200 件の iOS アプリを検査した結果として、103 件に同一の問題が存在することを確認した。この問題により、数千万件規模のファイルが露出していた。彼は、一般ユーザーを対象として、アプリの安全性を確認するための Web サイトも公開している。

その一方で Harry は、2026年1月20日に Codeway に対しても問題を通知している。この報告から数時間以内に、同社は全アプリで修正を実施したとされる。しかし、修正前の長期間にわたって、機密情報が公開状態だった可能性がある。インターネット上に一度公開された情報が、第三者に複製されたかどうかを確認することは困難である。このインシデントが示すのは、個人データの安全性を確認する際にも、最終的に一人の開発者のチェックリストに依存せざるを得ないという現実である。

自己防衛のために避けるべきことは、本名の使用や銀行明細など機微な文書を、チャットボットと共有することである。これらのツールを利用する際には、ソーシャルメディアとのアカウント連携機能を避け、独立した強力なパスワードを使用することが望ましい。将来において公開され得るという前提で、すべての会話を扱い、共有内容に最大限注意する必要がある。

DryRun Security CEO である James Wickett は、「AI が実際の製品に組み込まれると、リスクは現実化していく。今回の AI チャット・アプリ侵害は、新規の AI 攻撃ではない。従来型バックエンド設定ミスであり、機微なデータを扱っていたことで、きわめて危険性が高まったにすぎない」と Hackread に述べている。

AI システムが実製品に組み込まれた時点で、プロンプト・インジェクション/データ漏洩/不適切な出力処理は、学術的な問題ではなくなる。その時点で、モデルはシステム内の信頼できない主体の一つとなる。入力も出力も汚染され得るため、アプリケーション側が明示的に境界を強制しなければならない。

James Wickett は、「約 3 億件のプライベート・メッセージと 2,500 万人のユーザーに関連する侵害である、新しい AI エクスプロイトではない。機微データゆえに、きわめて深刻化した従来型バックエンド・ミスコンフィグである。2026年のアプリケーション・セキュリティ最前線とは、従来の AppSec 障害と大規模 AI システムが衝突する領域であり、現在の主要リスクは、そこに集中している」と説明している。

Chat & Ask AI における情報漏洩の原因は、Firebase のミスコンフィグにあります。Security Rules における公開設定の状態が、認証を必要としないデータベースへのアクセスという状況を引き起こしました。その結果、Chat & Ask AI の約 3 億件のメッセージと 2,500 万人超のユーザー情報が外部から閲覧/削除できるようになっていました。高度な攻撃ではなく、バックエンド設定不備が直接の要因です。AI サービスであっても、基本的なアクセス制御を誤れば、大量の機微な会話データが一括で露出してしまう構造的な問題があります。よろしければ、2026/02/10 の「Chat & Ask AI に深刻なデータ漏洩:2500 万人のユーザーと 3 億件のメッセージに影響」も、ご参照ください。

You must be logged in to post a comment.